Im Jahr 2024 ist es einfacher geworden, durch künstliche Intelligenz realistische Bilder von Menschen zu erstellen, was zu Bedenken hinsichtlich der Erkennung dieser Falschmeldungen führt. Forscher der University of Hull Es wurde kürzlich enthüllt Eine neue Möglichkeit, gefälschte Bilder zu erkennen, die durch künstliche Intelligenz erstellt wurden, indem Reflexionen im menschlichen Auge analysiert werden. Diese Technologie wurde eingeführt Nationales Astronomisches Treffen der Royal Astronomical Society Letzte Woche wurden die Werkzeuge, mit denen Astronomen Galaxien untersuchen, angepasst, um die Konsistenz der Lichtreflexionen in unseren Augäpfeln zu untersuchen.

Adegumoke Owolabi, ein Masterstudent an der University of Hull, leitete die Forschung unter der Aufsicht von Dr Kevin PimblettProfessor für Astrophysik.

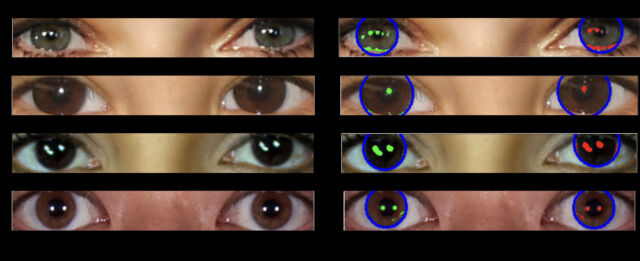

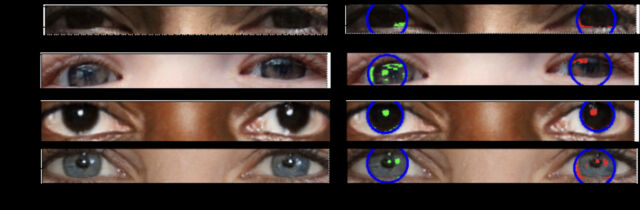

Ihre Erkennungstechnik basiert auf einem einfachen Prinzip: Ein Augenpaar, das von denselben Lichtquellen beleuchtet wird, weist in der Regel in jedem Auge einen ähnlich geformten Satz Lichtreflexionen auf. Viele KI-generierte Bilder berücksichtigen bisher keine Augenreflexionen, sodass simulierte Lichtreflexionen zwischen den einzelnen Augen oft inkonsistent sind.

In gewisser Weise ist der astronomische Winkel für diese Art der Deepfake-Erkennung nicht immer notwendig, da ein kurzer Blick auf ein Augenpaar in einem Bild Reflexionsunterschiede aufdecken kann Künstler malen Porträts Der Einsatz astronomischer Tools zur automatischen Messung und Quantifizierung von Augenreflexionen in gefälschten Videos ist jedoch eine neue Entwicklung.

Automatische Erkennung

In der Royal Astronomical Society Blog In einem von The Verge veröffentlichten Artikel erklärte Pimblett, dass Owolabi eine Technik zur automatischen Erkennung von Augapfelreflexionen entwickelt und die morphologischen Merkmale der Reflexionen anhand von Indikatoren analysiert habe, um die Ähnlichkeit zwischen dem rechten und dem linken Augapfel zu vergleichen. Ihre Ergebnisse zeigten, dass gefälschte Videos oft Unterschiede zwischen den Augen zeigen.

Das Team wandte Methoden der Astronomie an, um Augapfelreflexionen zu messen und zu vergleichen. Und sie wurden genutzt Gini-Koeffizientnormalerweise verwendet für Messung der Lichtverteilung in GalaxienbildernZur Beurteilung der Konsistenz von Reflexionen über Augenpixel hinweg. Ein Gini-Wert näher bei 0 zeigt an, dass das Licht gleichmäßig verteilt ist, während ein Wert näher bei 1 anzeigt, dass das Licht auf ein einzelnes Pixel konzentriert ist.

In dem Artikel der Royal Astronomical Society zog Pimblett Vergleiche zwischen der Art und Weise, wie die Form der Reflexion eines Augapfels gemessen wird, und der Art und Weise, wie die Form einer Galaxie typischerweise in Teleskopbildern gemessen wird: „Um die Formen von Galaxien zu messen, analysieren wir, ob sie zentral kompakt sind, ob sie symmetrisch sind und wie glatt sie sind. Wir analysieren die Lichtverteilung.

Die Forscher untersuchten auch die Verwendung von CAS-Parameter (Fokus, Asymmetrie, Glätte), ein weiteres Werkzeug der Astronomie zur Messung der Verteilung des galaktischen Lichts. Allerdings hat sich diese Methode bei der Identifizierung falscher Augen als weniger effektiv erwiesen.

Das Wettrüsten bei der Erkennung

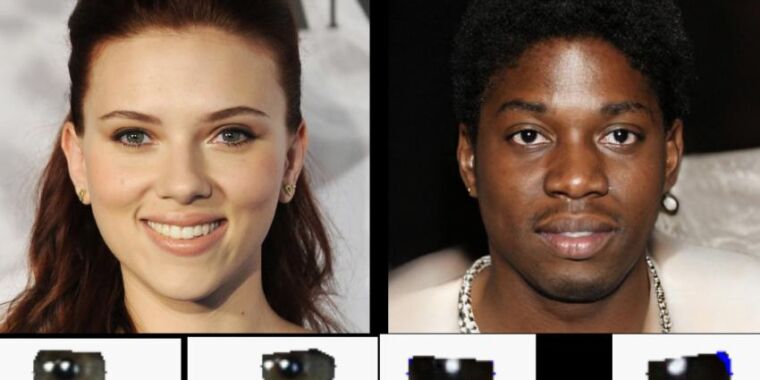

Obwohl die Augenreflexionstechnologie einen potenziellen Weg zur Erkennung von KI-generierten Bildern bietet, funktioniert diese Methode möglicherweise nicht, wenn sich KI-Modelle dahingehend entwickeln, physikalisch genaue Augenreflexionen einzubeziehen, die möglicherweise als späterer Schritt nach der Bilderzeugung angewendet werden. Damit diese Technik funktioniert, ist auch eine klare Nahansicht der Augäpfel erforderlich.

Bei diesem Ansatz besteht auch die Gefahr falsch positiver Ergebnisse, da selbst Originalbilder aufgrund unterschiedlicher Lichtverhältnisse oder Nachbearbeitungstechniken manchmal inkonsistente Reflexionen für das Auge aufweisen können. Die Augenreflexionsanalyse kann jedoch immer noch ein nützliches Werkzeug in einem größeren Deepfake-Erkennungs-Toolkit sein, das auch andere Faktoren wie Haartextur, Anatomie, Hautdetails und Hintergrundsymmetrie berücksichtigt.

Obwohl diese Technologie kurzfristig vielversprechend ist, warnte Dr. Pimblett, dass sie nicht perfekt sei. „Es gibt falsch-positive und falsch-negative Ergebnisse; diese Technik wird nicht alles erkennen. Aber diese Methode gibt uns eine Grundlage und einen Angriffsplan im Wettrüsten, um gefälschte Aufnahmen zu erkennen“, sagte er der Royal Astronomical Society.

:max_bytes(150000):strip_icc()/When-You-Eat-Watermelon-Regularly-af3654d0fcac4b7897868c582e7a6207.jpg)